概述今天我要跟大家分享一下如何在单机上部署kafka3.5,并配置sasl认证(plaintext模式)。kafka是一个分布式的消息队列,可以用来处理大量的数据流。sasl是一种安全认证机制,可以保证kafka的通信安全。下面我会分几个步骤来介绍这个过程。第一步,安装kafka下载并解压kafka3.5的安装包。你可以从官网或者其他镜像站点下载kafka的压缩文件,然后解压到你想要的目录。例如,我把它解压到了/home/kafka目录。第二步,修改kafka的配置文件你需要...

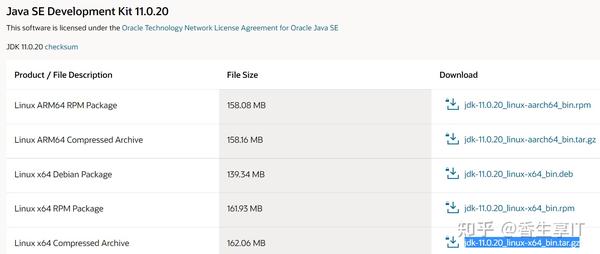

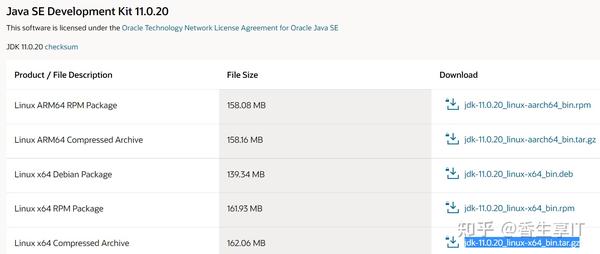

引言 近年来,随着大数据和分布式系统的快速发展,数据传输和处理的需求也越来越大。在这个背景下,Apache Kafka作为一款高性能、高可靠性的分布式流媒体平台,吸引了众多企业和开发者的关注。与此同时,随着安全和数据保护意识的提升,数据传输的安全性也变得尤为重要。正因如此,深入了解Kafka集群的安装和认证机制显得尤为重要。本文将为大家介绍如何搭建一个具有SASL认证机制的Kafka集群环境,并分享一些实验经验和注意事项。本文主要以3虚拟机测试环境安装了JDK 11, Zoo...

/

1657 次浏览/

Kafka

本文使用版本:Kafka 3.6.0有时我们会碰到网络是通畅的,但却连不上Kafka,特别是在多网卡环境或者云环境上很容易出现。这个其实和Kafka的监听配置有关系。本文介绍监听相关的配置。目前监听相关的参数主要有下面几个:listeners

advertised.listeners

listener.security.protocol.map

inter.broker.listener.name

security.inter.broker.protocol

adv...

/

1578 次浏览/

Kafka

这里的内网和外网并不必须是是我们通常说的公司内部网络和公网,只要是两块网卡都可以,不管是这两块网卡是公网、内网、甚至是k8s的虚拟网络两个网段的主要目的是实现分流,一个负责节点间通信,一个负责对外收发消息总结一句话:listeners 指明 kafka 当前节点监听本机的哪个网卡advertised.listeners 指明客户端通过哪个 ip 可以访问到当前节点1. kafka的两个配置listeners和adve...

/

1476 次浏览/

Kafka

clickhouse默认数据目录是: /var/lib/clickhouse。修改方案:先停止数据库,然后转移该目录到指定位置,最后软连接回原地址并启动;即无需修改config.xml实现对数据目录的修改。1、停止数据库service clickhouse-server stopmkdir /cc/soft/clickhouse2、迁移数据目录修改权限,否则没权限就启动不了数据量太大,较慢,耐心等待。mv /var/lib/clickhouse/* /cc/sof...

clickhouse版本:22.2.2.1更改default账户权限ClickHouse提供了一个default账号,这个账号有所有的权限,但是不能使用SQL驱动方式的访问权限和账户管理。我们需要在配置文件中修改default账户,使其能够通过SQL驱动方式添加角色和用户。默认default用户是没有办法创建用户的,这时候需要我们修改配置文件users.xml,便能创建用户了,详见官网修改 /etc/clickhouse-server/users.xml 文件,在<us...

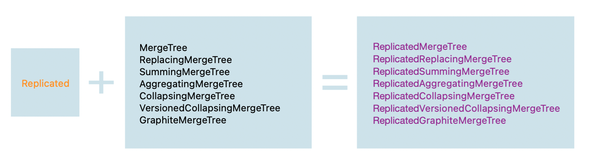

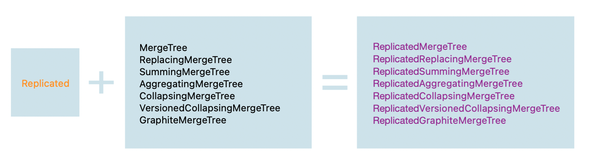

ClickHouse 是俄罗斯最大的搜索引擎Yandex在2016年开源的数据库管理系统(DBMS),主要用于联机分析处理(OLAP)。其采用了面向列的存储方式,性能远超传统面向行的DBMS,近几年受到广泛关注。本文将介绍ClickHouse MergeTree系列表引擎的相关知识,并通过示例分析MergeTree存储引擎的数据存储结构。1 MergeTree表引擎简介 MergeTree(合并树)系列表引擎是Click...

通过mybatis也可以实现批量写入clickhouse,但是效率太低,每秒大概只能写入300条数据,对于动辄上千万的数据或者更多数据,效率就太低了。而采用jdbc驱动的方式进行批量写入,每秒大约写入数据量达到10000条,效率得到大幅度的提升,只是这种方式,需要编写的代码会更多,需要处理的细节也更多。1. 添加依赖<!--clickhouse-->

<dependency>

<groupId&...

总结分区目录可以不断被合并,最终可能被合并成一个目录分区目录数据量最大可达150G插入的数据只有落地到磁盘之后,客户端才能查询到数据数据写入类似于kafka:支持同步,异步写入。支持最近数据插入去重校验数据块合并之后,旧的数据块默认情况下会在480s之后 被删除注意:不活动的数据块:数据被合并后旧的数据块活动的数据块:合并新生成 或 刚写入的 数据块 数据块就是:表数据目录下生成的存储数据的目录配置说明max_parts_in_total如果表的所有分区中的活动数据...

1、clickhouse应⽤场景1.绝大多数请求都是用于读访问的2.数据需要以大批次(大于1000行)进行更新,而不是单行更新;或者根本没有更新操作3.数据只是添加到数据库,没有必要修改4.读取数据时,会从数据库中提取出大量的行,但只用到一小部分列5.表很“宽”,即表中包含大量的列6.查询频率相对较低(通常每台服务器每秒查询数百次或更少)7.对于简单查询,允许大约50毫秒的延迟8.列的值是比较小的数值和短字符串(例如,每个URL只有60个字节)9.在处理单个查询时需要高吞吐量...